Womit verbringt eine Person, deren Spezialgebiet die Datenanalyse ist, den größten Teil ihrer Zeit? Sicherlich wird jeder, der kein Analyst ist, antworten, dass seine Aufgabe darin besteht, Daten zu analysieren und die Ergebnisse zu präsentieren. In einer idealen Welt wäre dies sicherlich die Realität, und die Berichterstattung wäre eine einfache und angenehme Tätigkeit. Aber was ist dann die größte Herausforderung für jeden Datenanalysten? Mit einer Antwort: die Datenaufbereitung.

Jeder Datenreporter würde sicherlich gerne saubere Datensätze mit standardisierten Spaltennamen erhalten. Ebenfalls lästig für Analysten sind ungewöhnliche und ausreißerische, nicht ausgefüllte (Null-)Werte an jeder Stelle. Nachdem Sie diese Probleme beseitigt haben, müssen Sie nur noch weitere Visualisierungen erstellen. Danach – interpretieren Sie ihre Ergebnisse und überraschen Sie Ihre Vorgesetzten mit tief verborgenen Einsichten, noch nie dagewesenen Entdeckungen und wertvollen Empfehlungen. Dann erreicht unser Unternehmen ein Wachstum, das weit über dem Marktwachstum liegt. Nach einiger Zeit wird es zu einem Weltmarktführer und der Analyst zu einer lebenden Legende. Eine schöne Vision, aber die Welt sieht anders aus. Warum ist es so schwer, gute Daten zu finden, denen man vertrauen kann? Das Problem tritt sehr oft in der Anfangsphase der Datenanalyse auf.

Die Herausforderungen eines Datenanalysten

Die größte Herausforderung für jeden Spezialisten, dessen Haupttätigkeit die Datenanalyse ist, besteht in der Handhabung, Umwandlung und Vorbereitung des Datensatzes für die Analyse. Leider erfordern Daten, die Ereignisse im Unternehmen beschreiben, immer eine angemessene Verwaltung – Kontrolle der korrekten Vervollständigung, Behandlung ungewöhnlicher Ereignisse, Implementierung neuer Informationsstrukturen. Der Umfang dieser Aufgabe zwingt oft zur Schaffung einer separaten Position, die für das Data Engineering verantwortlich ist – ihre Aufbereitung, die Planung der Berichtsstruktur und die technologische Architektur hinter dem gesamten Prozess.

Unabhängig von der Größe unseres Unternehmens, der Struktur der Analyseabteilung und der Qualität der Daten sollte jedoch jede Datenanalyse mit der Vorbereitung des Datensatzes für die Analyse und seine Visualisierung beginnen. An dieser Stelle kommt die explorative Datenanalyse (EDA) ins Spiel. Dabei handelt es sich um einen Prozess, der zu Beginn der Arbeit eines Analysten durchgeführt wird. Er ermöglicht es ihm, sich mit der vorhandenen Struktur vertraut zu machen und mögliche Probleme zu bewältigen. In dieser Phase erwirbt der Analyst Informationen über die Sammlung selbst, beginnt sie zu verstehen und stellt ungewöhnliche Werte und Fehler in der Sammlung fest, die zusätzliche Maßnahmen erfordern. Worin besteht der Prozess der explorativen Datenanalyse?

Erfahren Sie in 5 einfachen Schritten, wie Sie Ihre Daten für eine effektive Analyse und Visualisierung Ihrer Ergebnisse richtig vorbereiten.

Datenanalyse und ihr Geschäftszweck – verstehen Sie Ihren Datensatz

Das Schlüsselelement der Datenanalyse besteht darin, zu prüfen und zu verstehen, womit wir es zu tun haben. In diesem Stadium sollten wir die Fragen beantworten:

- Woher kommen die Daten: wer gibt sie ein, wann, wie?

- Was genau bedeutet jede Spalte/Variable/Tabelle (z.B. ist das „Datum, an dem ein Mitarbeiter hinzugefügt wurde“ das Datum, an dem er eingestellt wurde, das Datum, an dem er dem System hinzugefügt wurde, das Datum, an dem er zu arbeiten begann)?

- Welche Werte finden sich in den einzelnen Teilen der Menge (besteht z.B. die Spalte mit dem Einstellungsdatum des Mitarbeiters nur aus gültigen Daten oder vielleicht auch aus Zahlen und Sätzen)?

- Was möchte ich letztendlich erreichen (ist dieser Satz geeignet, um die Datenanalyse erfolgreich zu gestalten)?

Es mag scheinen, dass die Antworten auf diese Fragen offensichtlich sind und dieser Schritt nur eine Formalität ist. Leider ist dieser Schritt oft sehr arbeitsintensiv. An verschiedenen Stellen im Datensatz können Werte auftauchen, die wir nicht verstehen, so dass wir erklären müssen, warum diese Werte auftreten und was sie bedeuten. In diesem Stadium erfahren wir zum Beispiel, dass die Variable, die dem Transaktionswert entspricht, neben Zahlen auch Ausdrücke wie „storniert“, „unbekannt“, „Raten“ enthält. Es kann sich auch herausstellen, dass ein Teammitglied, das in die Vereinigten Staaten delegiert wurde, die Vertragsdaten im Format MM/TT/JJJJ eingegeben hat, während der Rest des Teams – TT/MM/JJJJ.

Daher umfasst diese Phase der Analyse sowohl eine vorläufige Analyse der Sammlung in einem Analysetool (Business Intelligence-Tools wie Tableau, integrierte Entwicklungsumgebungen wie PyCharm usw.) als auch eine gründliche Überprüfung der Metadaten der Sammlung und einen Vergleich unserer Ergebnisse mit dem Team, um alle Zweifel zu klären.

Nachdem wir diese Phase korrekt durchgeführt haben, sollten wir Informationen über die notwendigen Transformationen der Daten in der Sammlung erhalten. Ihre Leistung ist für die weitere Analyse erforderlich.

Optimieren Sie Ihren Datensatz

Im zweiten Schritt des Prozesses sollten wir uns auf die technische Optimierung des Datensatzes konzentrieren. Das bedeutet, dass wir für jede untersuchte Spalte/Variable/Tabelle zwei Fragen beantworten müssen:

- Ist das Objekt (z.B. Tabelle, Spalte, Variable) für diese Analyse nützlich (wenn nicht, sollte es entfernt werden)?

- Hat das Objekt den richtigen Datentyp (z.B. sind die Zahlen definitiv Integer/Floats und keine Strings)?

Dieser Schritt ist zwar einfach anzuwenden, aber extrem wichtig. Bei mittleren und großen Datensätzen kann er die Arbeit daran sogar um ein Vielfaches beschleunigen. Wenn die Datenanalyse mit einer flachen Tabelle durchgeführt wird, die mehrere tausend Datensätze und mehrere Dutzend Spalten enthält, kann dieser Schritt ihre Größe erheblich reduzieren. Dies wirkt sich auf die Analysezeit aus. Die Erstellung eines einfachen Diagramms dauert nur noch eine statt etwa ein Dutzend Sekunden, und die Ausführung eines vollständigen Analyseskripts dauert nur noch wenige statt etwa ein Dutzend Minuten. Dies sind keine großen Zahlen. Es ist jedoch wichtig, daran zu denken, dass ein Skript beim Erstellen und Testen mehrmals ausgeführt werden muss…

In diesem Schritt führen wir eine Transformation der verfügbaren Daten durch. Dies ist eine einfache Aufgabe, die in den meisten Analysetools durchgeführt werden kann. Denken Sie an die Datentypen, die von unserer Analyseumgebung unterstützt werden, und versuchen Sie immer, den benötigten Speicherplatz zu minimieren.

Vermeiden Sie die „speicherintensivsten“ Typen wie string (Wörter, Zeichenketten). Wählen Sie stattdessen die speichereffizientesten Typen, wie z.B. boolean (wahr/falsch).

Verwalten Sie Datenlücken angemessen

Der nächste Schritt bei der Datenaufbereitung ist die ordnungsgemäße Verwaltung von fehlenden Daten in der Datenbank. In jeder Produktionsdatenbank werden wir auf eine Situation stoßen, in der ein Wert für ein bestimmtes Objekt leer ist. Ein klassischer Fehler in einem solchen Fall ist es, diesem Wert eine Null zuzuweisen. Das Fehlen von Daten in ausgewählten Zellen bedeutet jedoch nicht, dass dort der Wert Null steht, und es gibt keine Grundlage für eine solche Aktion. Und was ist, wenn in der Spalte ein Datum oder eine Produktbeschreibung stehen sollte, aber keine Zahl? In diesem Fall können wir erst recht nicht die fehlende Zahl durch eine Null ersetzen.

In einem ersten Schritt müssen wir die Art der auftretenden Defizite anhand ihrer Entstehung identifizieren. Auf diese Weise werden wir unterscheiden:

- menschliche Fehler (ein bestimmter Wert hätte ausgefüllt werden müssen, aber die dafür zuständige Person hat es nicht getan);

- echte Lücken (aufgrund der Besonderheiten des Datensatzes sollte der Wert in der Tat leer sein, z.B. sollte der Wert der Variablen „zuletzt gekauftes Produkt“ für einen Kunden, der noch keinen Kauf auf unserer Plattform getätigt hat, leer sein).

Bei echten Mängeln hängt es von unserer Analyse ab, wie sie behandelt werden. In den meisten Fällen werden Datensätze mit Lücken jedoch nicht verändert und bei der Präsentation der Ergebnisse als eigene Kategorie von Datensätzen behandelt. Es ist jedoch richtig, dass einige Analysen bei einem solchen Datensatz nicht möglich sind.

Mängel, die auf menschliches Versagen zurückzuführen sind, erfordern eine Vereinbarung innerhalb des Teams/Managements, um sie zu behandeln. Das ist möglich:

- die Festlegung des Wertes, der die Lücken ersetzen soll (z.B. unterstellen wir im Voraus das Datum 01/01/2000 für jede Lücke im Feld „Beschäftigungsdatum“ oder den durchschnittlichen Auftragswert für die Lücke im Feld „Auftragswert“; alternativ können Datenlücken durch Imputation entsprechend der Verteilungen der Variablen ersetzt werden);

- das Füllen der Lücken mit angemessenen Werten durch die verantwortlichen Teammitglieder (was möglicherweise nicht möglich ist, wenn der Umfang der Lücken erheblich ist oder sie sich auf zeitlich weit entfernte Ereignisse beziehen);

- Lücken zu hinterlassen (wenn ihr Auftreten die Analyse nicht wesentlich beeinträchtigt);

- das Entfernen fehlerhafter Datensätze aus der Analyse (was den Verlust einiger Informationen bedeutet, aber manchmal notwendig sein kann, wenn die Mängel die Realität erheblich verzerren können).

Bestimmen Sie die Verteilungen der Variablen und identifizieren Sie Ausreißer

Sobald die Daten nach den oben genannten Grundsätzen bereinigt wurden, ist es an der Zeit, ihre Struktur besser zu verstehen. Wir wissen jetzt zum Beispiel, dass die Werte für den Zahlungsverzug bei Rechnungen ganze Zahlen sind, die der Anzahl der Tage entsprechen. Aber wie setzen sich diese Werte in Bezug auf die Häufigkeit/Dichte des Auftretens zusammen? Sind die Kunden am häufigsten um maximal eine Woche im Verzug? Sind diese Werte in unserem Fall gleichmäßig über das Jahr verteilt? Gibt es Ausreißer, d.h. Kunden sind im Allgemeinen höchstens eine Woche zu spät, aber ein Auftragnehmer ist 600 Tage zu spät?

Ein Blick auf die Daten

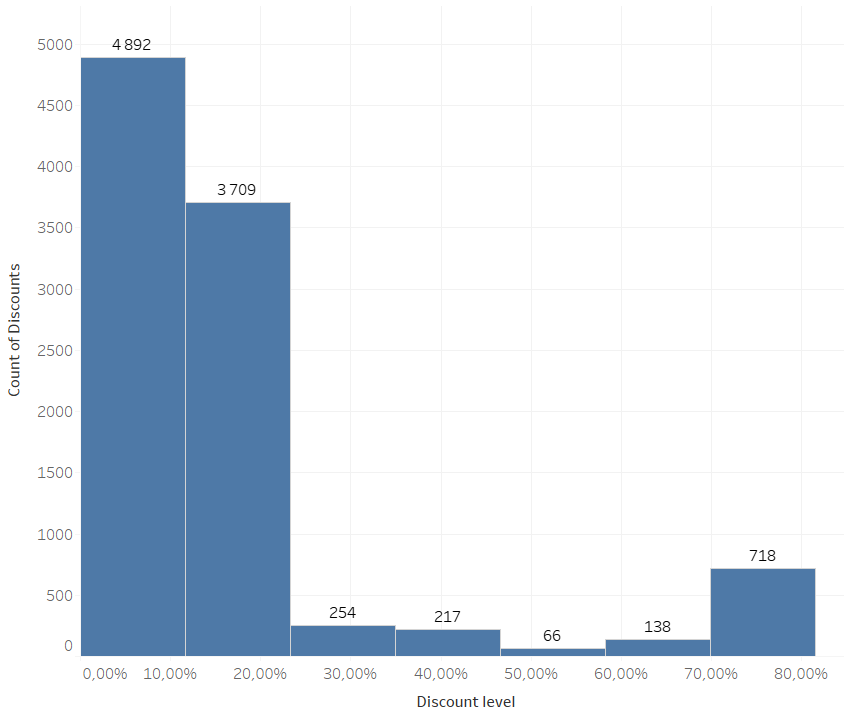

Als Teil dieses Schritts sollte für jedes untersuchte Objekt ein Dichteplot oder ein Histogramm erstellt werden (unten sehen Sie ein Beispiel für eine Analyse der in einem bestimmten Geschäft angebotenen Rabatte). Solche Visualisierungen helfen uns zu verstehen, wie unsere Werte verteilt sind und wo wir Ausreißer erwarten können.

Anhand des obigen Diagramms können wir sehen, dass der Umfang der Preissenkungen nicht symmetrisch verteilt ist. Kleine Preisnachlässe (bis zu 20%) dominieren. Gleichzeitig liegen große Rabatte im Bereich von 70-80% bereits an dritter Stelle, was die Häufigkeit angeht. Dies könnte auf die Strategie des Unternehmens in Bezug auf Preisnachlässe hindeuten, derzufolge der Preisnachlass klein oder erheblich sein sollte. Das liegt daran, dass Rabatte in der Mitte des Stapels keine Aufmerksamkeit erregen, während sie Geld kosten.

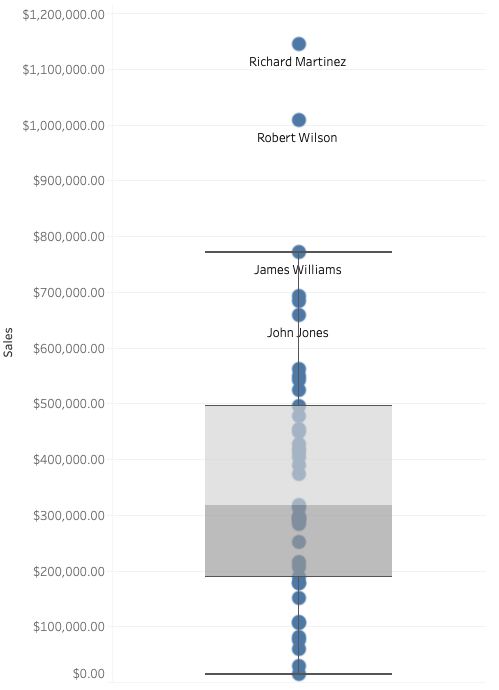

Nach einer solchen Analyse sollten weitere Statistiken für jeden Probanden überprüft werden. Nämlich Mittelwert, Median, Standardabweichung, Werte für das erste und dritte Quartil. Um sie leicht zu interpretieren, können Sie ein Boxplot (Diagramm unten) verwenden, das einige dieser Statistiken zeigt.

Aus der obigen Grafik können wir ablesen:

- Median (die Grenze der beiden grauen Rechtecke in der Mitte),

- das erste und dritte Quartil (die untere und obere äußere Grenze der beiden grauen Rechtecke),

- der Interquartilsbereich (die Länge der beiden grauen Rechtecke),

- erstes und drittes Quartil mit dem subtrahierten bzw. addierten Wert der vierteljährlichen Spanne multipliziert mit 1,5 (die äußersten horizontalen Linien, die so genannten „Whiskers“; im Falle dieser Grafik endet die untere Grenze bei Null, da der Umsatzwert nicht negativ sein kann),

- die Ergebnisse der einzelnen Verkäufer (Punkte).

Anhand der Beispieltabelle können wir sehen, dass sich zwei Verkäufer in Bezug auf den Verkaufswert von den anderen abheben. Es sind Richard Martinez und Robert Wilson. Gleichzeitig sind ihre Ergebnisse nicht unwahrscheinlich, so dass es keinen Grund gibt, einen Fehler in den Daten zu vermuten.

Schlussfolgerungen aus einer kursorischen Analyse

Obwohl in dieser Phase bereits typische analytische Arbeiten anfallen, Grafiken und Statistiken erstellt werden, sollte dieses Element nicht als vollständige Datenanalyse betrachtet werden. Diese Phase dient lediglich dazu, den Forscher mit den Merkmalen des Datensatzes vertraut zu machen. Außerdem – damit er mögliche Transformationen noch vor der eigentlichen Analyse vornehmen kann.

Gleichzeitig sollten wir in dieser Phase entscheiden, wie wir mit Ausreißern umgehen, z.B. für den erwähnten Fall, dass der Zahlungsverzug bei Rechnungen 600 Tage beträgt. In der Literatur findet man einen Ansatz, der die Anwendung der „Drei-Sigma-Regel“ vorschlägt. Dieser Begriff bedeutet, dass alle Beobachtungen abgelehnt werden, die mehr als drei Standardabweichungen vom Mittelwert abweichen. Beachten Sie jedoch, dass dieser Ansatz nur im Falle einer normalen Wahrscheinlichkeitsverteilung gerechtfertigt ist, bei der tatsächlich 99,7 % der Beobachtungen innerhalb des Bereichs liegen: Mittelwert +/- drei Standardabweichungen.

In der Realität können wir das Vorhandensein dieser Verteilung in unseren Daten nur selten bestätigen. Ein klassischer Fehler bei der Anwendung dieser Regel ist der Ausschluss von Kunden mit Einkaufswerten außerhalb des oben angegebenen Bereichs. Ein solch hoher Wert verzerrt die Analyse, kann aber gleichzeitig darauf hinweisen, dass der betreffende Käufer ein Geschäftskunde und kein Privatkunde ist. Daher sollte er nicht ausgeschlossen, sondern separat analysiert werden, in einer Untergruppe von Datensätzen, die Unternehmen entsprechen.

Dementsprechend besteht der beste Ansatz für den Umgang mit Ausreißern darin, jede Variable einzeln zu betrachten und entsprechend ihrer Verteilung, Statistik und Aussagekraft zu entscheiden. Wie bei fehlenden Daten können wir diesen Wert durch einen anderen ersetzen, ihn aus der Menge entfernen oder ihn unverändert lassen.

Prüfen Sie Beziehungen und Korrelationen zwischen Variablen

Der letzte Schritt einer ordnungsgemäßen explorativen Datenanalyse besteht darin, die Beziehungen und Korrelationen zu prüfen, die zwischen den untersuchten Variablen bestehen. Dieser Schritt beinhaltet die Überprüfung des gemeinsamen Auftretens bestimmter Kategorien und Werte einzelner Variablen in unserem Datensatz.

Die wichtigste Aktivität dieses Schritts ist die Bestimmung von Korrelationsmaßen. Im klassischsten Fall ist dieses Maß der lineare Korrelationskoeffizient von Pearson, der uns anzeigt, ob z.B. bei einem Anstieg des Wertes der einen Variablen die Werte der anderen Variablen steigen oder sinken. Alternativ, z.B. im Falle einer Variable mit Ausreißern, kann der Spearman-Rangkorrelationskoeffizient verwendet werden, der die Beziehungen in einem solchen Fall besser wiedergibt.

Mit der Korrelations- und Co-Occurrence-Analyse können wir die Gültigkeit und Konsistenz unserer Daten mit der Intuition überprüfen. Wenn die Analyse zeigt, dass Werte höherer Ordnung für einzelne Kunden und nicht für Unternehmen auftreten, kann dies auf Fehler in der Menge hinweisen, die auf keiner der vorherigen Analyseebenen entdeckt wurden. Gleichzeitig können wir auf dieser Stufe bereits die ersten Abhängigkeiten erkennen. Auf diese Weise können wir nahtlos zur eigentlichen Analyse des bereits bereinigten Datensatzes übergehen.

Die korrekte Ausführung der oben genannten Schritte verkürzt die analytische Arbeit am Set erheblich.

Dank der aufeinanderfolgenden Phasen kann der Forscher die Daten, d.h. das Material, an dem er arbeitet, gründlich verstehen. Dadurch werden viele Fehler und Missverständnisse in den nachfolgenden Phasen vermieden, und die Datenanalyse kann effektiv durchgeführt werden.

Wir empfehlen Ihnen auch, uns auf LinkedIn zu folgen.

Artikel von Karol Michalak.